qualité de données pilotée par les tests : pilotage et indicateurs

La qualité des données est devenue un enjeu majeur pour les entreprises modernes, car elle influence directement la prise de décision, l’efficacité opérationnelle et la satisfaction client. Dans un monde où les données sont omniprésentes, il est essentiel de s’assurer qu’elles sont précises, fiables et pertinentes. La qualité de données pilotée par les tests émerge comme une approche systématique pour garantir que les données répondent à des normes élevées.

En intégrant des tests rigoureux dans le processus de gestion des données, les organisations peuvent identifier et corriger les erreurs avant qu’elles n’affectent les opérations ou les décisions stratégiques. Cette approche repose sur l’idée que la qualité des données ne peut pas être laissée au hasard. Les tests permettent de valider les données à chaque étape de leur cycle de vie, depuis la collecte jusqu’à l’analyse.

En adoptant une méthodologie axée sur les tests, les entreprises peuvent non seulement améliorer la qualité de leurs données, mais aussi renforcer la confiance des parties prenantes dans les informations qu’elles utilisent. Cela est particulièrement pertinent dans des secteurs tels que la finance, la santé et le marketing, où des décisions basées sur des données erronées peuvent avoir des conséquences graves.

Résumé

- L’introduction à la qualité de données pilotée par les tests met en lumière l’importance de cette approche pour garantir la fiabilité des données.

- Les principes du pilotage de la qualité de données soulignent l’importance de la gouvernance, de la responsabilité et de la collaboration pour assurer la qualité des données.

- Les indicateurs clés de performance pour évaluer la qualité de données permettent de mesurer l’exactitude, l’exhaustivité, la cohérence et la pertinence des données.

- Les outils et méthodes pour piloter la qualité de données incluent la normalisation, la déduplication, la validation et la surveillance continue des données.

- L’importance du test et de la validation des données dans le pilotage de la qualité met en évidence le rôle crucial de ces processus pour garantir la fiabilité des données.

Les principes du pilotage de la qualité de données

Le pilotage de la qualité des données repose sur plusieurs principes fondamentaux qui guident les organisations dans leur quête d’excellence. Tout d’abord, il est crucial d’établir des normes claires et mesurables pour la qualité des données. Ces normes peuvent inclure des critères tels que l’exactitude, la complétude, la cohérence et l’actualité.

En définissant ces critères, les entreprises peuvent créer un cadre de référence pour évaluer et améliorer la qualité de leurs données. Un autre principe clé est l’engagement des parties prenantes. La qualité des données ne peut être assurée sans la collaboration active de toutes les équipes impliquées dans le traitement des données, y compris les équipes IT, marketing et opérationnelles.

En favorisant une culture de responsabilité partagée, les organisations peuvent s’assurer que chaque membre comprend l’importance de la qualité des données et s’engage à respecter les normes établies. Cela nécessite également une formation continue et une sensibilisation aux enjeux liés à la qualité des données.

Les indicateurs clés de performance pour évaluer la qualité de données

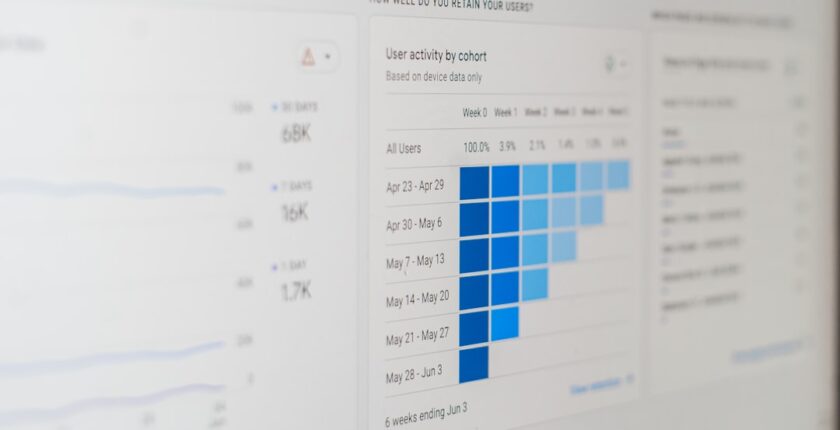

Pour évaluer efficacement la qualité des données, il est essentiel d’utiliser des indicateurs clés de performance (KPI) pertinents. Ces KPI permettent aux entreprises de mesurer leur performance en matière de qualité des données et d’identifier les domaines nécessitant des améliorations. Parmi les indicateurs couramment utilisés, on trouve le taux d’erreur, qui mesure le pourcentage d’enregistrements contenant des erreurs par rapport au total des enregistrements.

Un autre KPI important est le taux de complétude, qui évalue le pourcentage d’attributs remplis par rapport à ceux qui devraient l’être. Par exemple, dans une base de données client, un faible taux de complétude pourrait signifier que certaines informations essentielles, comme l’adresse ou le numéro de téléphone, sont manquantes.

De plus, le temps de latence dans la mise à jour des données peut également être un indicateur clé, car il reflète l’actualité des informations disponibles pour la prise de décision. En surveillant ces KPI, les entreprises peuvent obtenir une vue d’ensemble de leur performance en matière de qualité des données et ajuster leurs stratégies en conséquence.

Les outils et méthodes pour piloter la qualité de données

Pour piloter efficacement la qualité des données, les entreprises disposent d’une variété d’outils et de méthodes qui facilitent l’évaluation et l’amélioration continue. Parmi ces outils, on trouve les logiciels de gestion de la qualité des données (DQMS), qui permettent d’automatiser le processus d’évaluation et de nettoyage des données. Ces solutions offrent souvent des fonctionnalités telles que la détection des doublons, la validation des formats et l’analyse statistique pour identifier les anomalies.

En outre, les méthodes telles que l’analyse statistique et le data profiling sont essentielles pour comprendre la structure et la distribution des données. L’analyse statistique permet d’identifier les tendances et les modèles dans les données, tandis que le data profiling aide à évaluer la qualité en examinant les valeurs individuelles et en détectant les incohérences. L’utilisation combinée de ces outils et méthodes permet aux entreprises d’adopter une approche proactive pour gérer la qualité des données plutôt que réactive.

L’importance du test et de la validation des données dans le pilotage de la qualité

Les tests et la validation des données jouent un rôle central dans le pilotage de la qualité. Ils permettent non seulement d’identifier les erreurs existantes, mais aussi d’évaluer l’intégrité et la fiabilité des systèmes qui génèrent ou traitent ces données. Par exemple, lors du développement d’une nouvelle application ou d’un système d’information, il est crucial d’effectuer des tests rigoureux pour s’assurer que les données saisies sont correctement enregistrées et que les rapports générés sont précis.

La validation peut également inclure des vérifications croisées avec des sources externes pour garantir que les informations sont à jour et exactes. Par exemple, une entreprise peut comparer ses bases de données clients avec celles fournies par un service tiers pour s’assurer qu’il n’y a pas d’incohérences majeures. En intégrant ces pratiques dans le cycle de vie des données, les organisations peuvent réduire considérablement le risque d’erreurs qui pourraient compromettre leur prise de décision.

Les bonnes pratiques pour garantir la qualité des données

Pour garantir une qualité optimale des données, plusieurs bonnes pratiques doivent être mises en œuvre au sein des organisations. Tout d’abord, il est essentiel d’établir un processus clair pour la collecte et le traitement des données. Cela inclut la définition de protocoles standardisés pour l’entrée de données afin de minimiser les erreurs humaines.

Par exemple, l’utilisation de formulaires numériques avec validation intégrée peut aider à garantir que seules des informations valides sont saisies. Ensuite, il est important d’effectuer régulièrement des audits de qualité des données. Ces audits permettent d’identifier les problèmes potentiels avant qu’ils n’affectent les opérations ou les décisions stratégiques.

De plus, impliquer toutes les parties prenantes dans ce processus favorise une culture axée sur la qualité. En encourageant chaque équipe à prendre part à l’amélioration continue de la qualité des données, on crée un environnement où chacun se sent responsable du succès collectif.

Les défis et enjeux liés au pilotage de la qualité de données

Malgré l’importance croissante du pilotage de la qualité des données, plusieurs défis persistent dans sa mise en œuvre. L’un des principaux obstacles est souvent lié à la diversité et à la complexité croissante des sources de données. Avec l’essor du Big Data et l’intégration de multiples systèmes hétérogènes, il devient difficile d’assurer une cohérence et une intégrité à travers toutes ces sources.

Les entreprises doivent donc investir dans des solutions capables d’harmoniser ces différentes sources tout en maintenant un haut niveau de qualité. Un autre défi majeur réside dans le manque de sensibilisation et de formation au sein des équipes sur l’importance de la qualité des données. Souvent, les employés ne réalisent pas comment leurs actions peuvent influencer la qualité globale.

Cela souligne l’importance d’une communication claire sur les enjeux liés à la qualité des données et sur les conséquences potentielles d’une mauvaise gestion. En surmontant ces défis par une formation adéquate et en adoptant une approche systématique, les entreprises peuvent améliorer significativement leur pilotage de la qualité.

L’impact de la qualité de données sur la prise de décision et la performance de l’entreprise

La qualité des données a un impact direct sur la prise de décision au sein d’une entreprise. Des informations précises et fiables permettent aux dirigeants d’élaborer des stratégies éclairées basées sur une compréhension approfondie du marché et du comportement client. Par exemple, une entreprise qui utilise des analyses basées sur des données erronées risque de mal évaluer ses performances ou ses opportunités commerciales, ce qui peut entraîner une perte significative de revenus.

De plus, une bonne qualité des données contribue à améliorer l’efficacité opérationnelle. Lorsque les équipes disposent d’informations fiables, elles peuvent travailler plus rapidement et avec moins d’erreurs. Cela se traduit par une réduction du temps consacré à corriger les erreurs ou à rechercher des informations manquantes.

Les bénéfices d’une approche pilotée par les tests pour la qualité de données

Adopter une approche pilotée par les tests pour garantir la qualité des données présente plusieurs avantages significatifs pour les entreprises. Tout d’abord, cette méthode permet une détection précoce des erreurs, ce qui réduit considérablement le coût associé à leur correction ultérieure. En identifiant les problèmes dès leur apparition, les organisations peuvent éviter que ces erreurs ne se propagent dans leurs systèmes ou ne compromettent leurs analyses.

De plus, cette approche favorise une culture axée sur l’amélioration continue. En intégrant régulièrement des tests dans le cycle de vie des données, les équipes deviennent plus conscientes des enjeux liés à la qualité et s’engagent activement dans leur amélioration. Cela peut également renforcer la confiance entre différentes équipes au sein de l’organisation, car chacun comprend son rôle dans le maintien d’une base solide pour la prise de décision.

Les tendances et évolutions dans le domaine du pilotage de la qualité de données

Le domaine du pilotage de la qualité des données évolue rapidement avec l’avènement de nouvelles technologies et méthodologies. L’intelligence artificielle (IA) et l’apprentissage automatique (machine learning) commencent à jouer un rôle crucial dans l’automatisation du processus d’évaluation et d’amélioration de la qualité des données. Ces technologies permettent non seulement d’analyser rapidement d’énormes volumes de données mais aussi d’identifier automatiquement les anomalies qui pourraient passer inaperçues lors d’une analyse manuelle.

Par ailleurs, l’accent est mis sur l’intégration continue entre différents systèmes pour assurer une cohérence optimale dans le traitement des données. Les entreprises adoptent également davantage d’approches agiles pour s’adapter rapidement aux changements du marché tout en maintenant un haut niveau de qualité dans leurs processus décisionnels basés sur les données.

Conclusion et perspectives pour l’avenir de la qualité de données pilotée par les tests

À mesure que le volume et la complexité des données continuent d’augmenter, il devient impératif pour les entreprises d’adopter une approche systématique pour piloter leur qualité par le biais de tests rigoureux. L’avenir semble prometteur avec l’intégration croissante d’outils avancés tels que l’intelligence artificielle qui facilitent cette démarche tout en rendant le processus plus efficace et moins sujet aux erreurs humaines. Les organisations qui investissent dans cette approche non seulement améliorent leur performance opérationnelle mais renforcent également leur position concurrentielle sur le marché.

En fin de compte, garantir une haute qualité des données devient non seulement un impératif technique mais aussi un levier stratégique essentiel pour naviguer avec succès dans un environnement commercial en constante évolution.