qualité de données pilotée par les tests : modèle opératoire

La qualité des données est devenue un enjeu majeur pour les entreprises modernes, car elle influence directement la prise de décision, l’efficacité opérationnelle et la satisfaction client. Dans un monde où les données sont omniprésentes, il est essentiel de s’assurer qu’elles sont précises, complètes et fiables. La qualité de données pilotée par les tests se présente comme une approche systématique pour garantir que les données répondent aux normes requises.

En intégrant des tests rigoureux tout au long du cycle de vie des données, les organisations peuvent identifier et corriger les anomalies avant qu’elles n’affectent les processus métier. Cette approche repose sur l’idée que la qualité des données ne doit pas être un concept abstrait, mais plutôt un objectif mesurable et atteignable. En adoptant des méthodes de test adaptées, les entreprises peuvent non seulement améliorer la qualité de leurs données, mais aussi renforcer la confiance des parties prenantes dans les informations qu’elles utilisent.

Cela nécessite une compréhension approfondie des types de données traitées, des processus en place et des exigences spécifiques de chaque domaine d’activité.

Résumé

- Introduction à la qualité de données pilotée par les tests

- Les principes fondamentaux du modèle opératoire

- Les étapes clés de la mise en œuvre du modèle opératoire

- L’identification des besoins en qualité de données

- La définition des critères de qualité et des tests associés

Les principes fondamentaux du modèle opératoire

Le modèle opératoire pour la qualité de données repose sur plusieurs principes fondamentaux qui guident son application. Tout d’abord, il est crucial d’établir une gouvernance des données claire. Cela implique la désignation de responsables de la qualité des données au sein de l’organisation, qui auront pour mission de définir les normes et les politiques relatives à la gestion des données.

Une gouvernance efficace permet d’assurer une responsabilité partagée et une communication fluide entre les différentes équipes impliquées dans le traitement des données. Ensuite, l’engagement des parties prenantes est essentiel pour le succès du modèle opératoire.

En favorisant une culture axée sur la qualité, les entreprises peuvent s’assurer que chaque employé comprend l’importance des données précises et fiables et s’engage à respecter les normes établies.

Les étapes clés de la mise en œuvre du modèle opératoire

La mise en œuvre d’un modèle opératoire pour la qualité des données nécessite une approche structurée et méthodique. La première étape consiste à réaliser un audit des données existantes. Cet audit permet d’identifier les sources de données, d’évaluer leur qualité actuelle et de déterminer les lacunes à combler.

Par exemple, une entreprise peut découvrir que certaines bases de données contiennent des doublons ou des informations obsolètes, ce qui nuit à leur fiabilité. Une fois l’audit réalisé, il est important de définir une feuille de route pour l’amélioration de la qualité des données. Cette feuille de route doit inclure des objectifs clairs, des délais et des ressources nécessaires pour atteindre ces objectifs.

Par exemple, si une entreprise souhaite réduire le taux d’erreurs dans ses enregistrements clients, elle peut établir un plan d’action qui inclut la formation du personnel sur les meilleures pratiques de saisie de données et l’implémentation d’outils automatisés pour détecter les erreurs en temps réel.

L’identification des besoins en qualité de données

L’identification des besoins en qualité de données est une étape cruciale qui permet aux entreprises de comprendre quelles dimensions de la qualité doivent être améliorées. Cela commence par une analyse approfondie des processus métier et des types de données utilisés. Par exemple, une entreprise de vente au détail pourrait se concentrer sur la précision des informations relatives aux stocks, car cela a un impact direct sur la satisfaction client et les ventes.

Il est également essentiel d’impliquer les utilisateurs finaux dans ce processus d’identification. Les employés qui interagissent quotidiennement avec les données peuvent fournir des informations précieuses sur les problèmes qu’ils rencontrent et sur les améliorations nécessaires. En recueillant leurs retours, les entreprises peuvent mieux cibler leurs efforts pour améliorer la qualité des données et s’assurer que les solutions mises en place répondent réellement aux besoins opérationnels.

La définition des critères de qualité et des tests associés

Une fois que les besoins en qualité de données ont été identifiés, il est temps de définir des critères clairs qui serviront de référence pour évaluer la qualité des données. Ces critères peuvent inclure la précision, la complétude, la cohérence, l’actualité et l’accessibilité des données. Par exemple, pour un ensemble de données clients, un critère de précision pourrait stipuler que 95 % des adresses doivent être valides et actuelles.

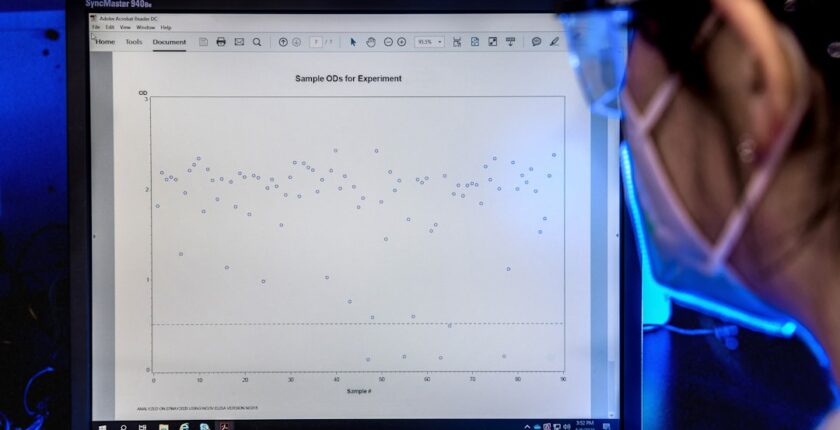

En parallèle, il est nécessaire d’élaborer des tests associés à ces critères. Ces tests doivent être conçus pour mesurer efficacement chaque dimension de la qualité définie précédemment. Par exemple, un test de complétude pourrait impliquer l’analyse d’un échantillon aléatoire d’enregistrements clients pour vérifier si tous les champs obligatoires sont remplis.

De même, un test de cohérence pourrait comparer les informations d’une base de données avec celles d’une autre source pour s’assurer qu’elles concordent.

La sélection des outils et des technologies appropriés

La sélection d’outils et de technologies adaptés est essentielle pour soutenir le processus de qualité des données. Il existe une multitude d’outils sur le marché qui offrent diverses fonctionnalités allant de l’automatisation des tests à l’analyse avancée des données. Par exemple, des solutions comme Talend ou Informatica permettent non seulement d’effectuer des tests de qualité, mais aussi d’intégrer et de transformer les données provenant de différentes sources.

Il est également important d’évaluer si ces outils peuvent s’intégrer facilement dans l’infrastructure technologique existante de l’entreprise. Une intégration fluide permet non seulement d’optimiser le flux de travail, mais aussi d’assurer que les équipes peuvent tirer parti des outils sans nécessiter une formation extensive. Par ailleurs, le choix doit également prendre en compte le coût total de possession, y compris les frais d’abonnement, le support technique et les mises à jour.

La création et l’exécution des tests de qualité de données

La création et l’exécution des tests de qualité sont des étapes cruciales dans le cadre du modèle opératoire. Cela commence par la rédaction de scénarios de test basés sur les critères définis précédemment. Chaque scénario doit être détaillé et inclure les étapes nécessaires pour exécuter le test ainsi que les résultats attendus.

Par exemple, un scénario visant à tester la précision des adresses pourrait inclure une vérification croisée avec un service externe qui valide les adresses postales. Une fois que les scénarios sont élaborés, il est temps de procéder à leur exécution. Cela peut être fait manuellement ou automatiquement selon les outils choisis.

L’exécution régulière des tests permet non seulement d’identifier rapidement les problèmes potentiels, mais aussi d’évaluer l’efficacité des mesures correctives mises en place précédemment. Par exemple, si un test révèle une augmentation du taux d’erreurs après une mise à jour du système, cela peut indiquer qu’une révision du processus est nécessaire.

L’analyse et la gestion des résultats des tests

L’analyse des résultats obtenus lors des tests est une étape essentielle pour comprendre l’état actuel de la qualité des données. Chaque test doit être documenté avec soin afin que les résultats puissent être analysés en profondeur. Cela inclut non seulement le taux d’erreurs détectées, mais aussi le type d’erreurs et leur impact potentiel sur les opérations commerciales.

Par exemple, si un test révèle que 10 % des enregistrements clients contiennent des erreurs dans le numéro de téléphone, cela peut avoir un impact direct sur la capacité à contacter ces clients pour des promotions ou du service après-vente. La gestion proactive des résultats implique également la mise en place d’un plan d’action pour corriger les problèmes identifiés. Cela peut inclure la mise à jour manuelle des enregistrements erronés ou l’ajustement du processus de saisie pour éviter que ces erreurs ne se reproduisent à l’avenir.

De plus, il est crucial d’établir un suivi régulier pour évaluer si les mesures correctives ont été efficaces et si la qualité globale s’est améliorée.

L’intégration de la qualité de données dans les processus métier

Pour que la qualité des données soit véritablement efficace, elle doit être intégrée dans tous les processus métier au sein de l’organisation. Cela signifie que chaque département doit être conscient de son rôle dans le maintien de la qualité des données et doit disposer des outils nécessaires pour y parvenir. Par exemple, le service marketing doit s’assurer que toutes les campagnes sont basées sur des listes clients à jour et précises afin d’éviter le gaspillage budgétaire.

De plus, il est essentiel que cette intégration soit soutenue par une formation continue du personnel sur l’importance de la qualité des données et sur les meilleures pratiques à adopter. Des sessions régulières peuvent être organisées pour sensibiliser tous les employés aux enjeux liés à la qualité des données et leur fournir les compétences nécessaires pour contribuer activement à son amélioration.

La surveillance continue et l’amélioration de la qualité de données

La surveillance continue est un élément clé pour garantir que la qualité des données reste élevée au fil du temps. Cela implique non seulement l’exécution régulière de tests, mais aussi l’établissement d’indicateurs clés de performance (KPI) qui permettent d’évaluer l’état général de la qualité des données au sein de l’organisation. Par exemple, un KPI pourrait mesurer le taux d’erreurs détectées par rapport au volume total de données traitées.

Cela signifie que même lorsque la qualité semble satisfaisante, il faut toujours chercher à identifier de nouvelles opportunités d’amélioration. Cela peut inclure l’exploration de nouvelles technologies ou méthodologies qui pourraient optimiser davantage le processus ou encore l’analyse régulière du retour d’expérience du personnel sur le terrain.

Conclusion et perspectives d’avenir

La qualité des données pilotée par les tests représente une approche stratégique essentielle pour toute organisation souhaitant tirer pleinement parti du potentiel offert par ses données. En mettant en place un modèle opératoire solide basé sur une gouvernance claire, une identification précise des besoins et une intégration efficace dans les processus métier, les entreprises peuvent non seulement améliorer leur efficacité opérationnelle mais aussi renforcer leur position concurrentielle sur le marché. À mesure que nous avançons vers un avenir où les volumes de données continuent d’exploser et où leur complexité augmente, il sera crucial pour les organisations d’adapter leurs stratégies en matière de qualité des données.

L’émergence de technologies telles que l’intelligence artificielle et l’apprentissage automatique offre également de nouvelles opportunités pour automatiser certains aspects du contrôle qualité tout en permettant une analyse plus approfondie et plus rapide des résultats obtenus. En somme, investir dans la qualité des données aujourd’hui est un gage de succès pour demain.