Les instituts de prévoyance face à machine learning : Check-list pour passer du pilote à l’industrialisation

Chers confrères et consœurs experts du monde de l’assurance et de la banque,

Le Machine Learning (ML) n’est plus une promesse lointaine dans nos secteurs ; il est devenu une réalité tangible, une force motrice qui remodèle nos opérations et redéfinit nos stratégies. Pour les Instituts de Prévoyance (IP), cette technologie représente une opportunité immense – une clé pour déverrouiller de nouvelles formes d’efficacité, d’innovation et, surtout, une meilleure gestion des risques et une personnalisation accrue des services. Cependant, nous savons tous, à l’expérience, que passer d’un projet pilote réussi à une industrialisation robuste et pérenne est un chemin semé d’embûches. Ce périple n’est pas une simple montée en puissance, mais une transformation fondamentale de nos infrastructures, de nos processus et, surtout, de nos mentalités.

Cet article a pour objectif de vous offrir une feuille de route, une « check-list » pragmatique, pour naviguer cette transition cruciale. Nous allons décortiquer les étapes clés, les défis inhérents et les bonnes pratiques qui vous permettront de faire de vos initiatives ML de véritables leviers de performance, plutôt que de simples expériences coûteuses.

Avant même de penser à déployer un modèle ML à grande échelle, un examen stratégique approfondi est indispensable. Il s’agit de s’assurer que vos ambitions en matière de ML sont non seulement techniquement réalisables, mais qu’elles sont intrinsèquement alignées avec la stratégie globale de votre Institut de Prévoyance et qu’elles répondent à des besoins métiers concrets et mesurables. Sans cet alignement, vos projets ML risquent de devenir des “jardins secrets” de data scientists, déconnectés des réalités opérationnelles et financiers.

1.1. Identification des Cas d’Usage Pertinents : De l’Intuition à la Preuve par les Chiffres

L’enthousiasme pour le ML peut parfois mener à une prolifération de projets théoriquement intéressants mais peu matérialisables en termes de bénéfices tangibles. Il est crucial de distinguer les “gadgets” technologiques des véritables leviers de performance.

- Priorisation basées sur le ROI potentiel : Chaque cas d’usage doit être évalué selon son impact potentiel sur des indicateurs clés de performance (KPI) financiers (réduction des coûts, augmentation des revenus, amélioration de la profitabilité) et opérationnels (gain de temps, automatisation des tâches, amélioration de l’expérience client). Un modèle qui permettrait de réduire de X% le délai de traitement des sinistres, ou d’identifier Y% de fraudes supplémentaires, représente une valeur intrinsèque beaucoup plus forte qu’une prédiction complexe dont le bénéfice reste flou.

- Scoring des cas d’usage : Mettez en place une grille d’évaluation qui prend en compte non seulement le potentiel de gain, mais aussi la faisabilité technique, la disponibilité des données, le coût de développement et de maintenance, et le risque associé. Un système de scoring pondéré vous aidera à attribuer des priorités justes.

- Exemples concrets en Prévoyance :

- Souscription et tarification : Modèles prédictifs pour évaluer le risque individuel et ajuster les primes en temps réel.

- Gestion des sinistres : Détection des fraudes, automatisation de l’évaluation des dommages, optimisation des processus d’indemnisation.

- Rétention et fidélisation : Identification des clients à risque de départ, personnalisation des offres et des communications.

- Marketing et vente : Ciblage précis des campagnes, recommandations personnalisées de produits de prévoyance.

- Gestion des actifs : Optimisation des portefeuilles d’investissement, prévision des flux de trésorerie.

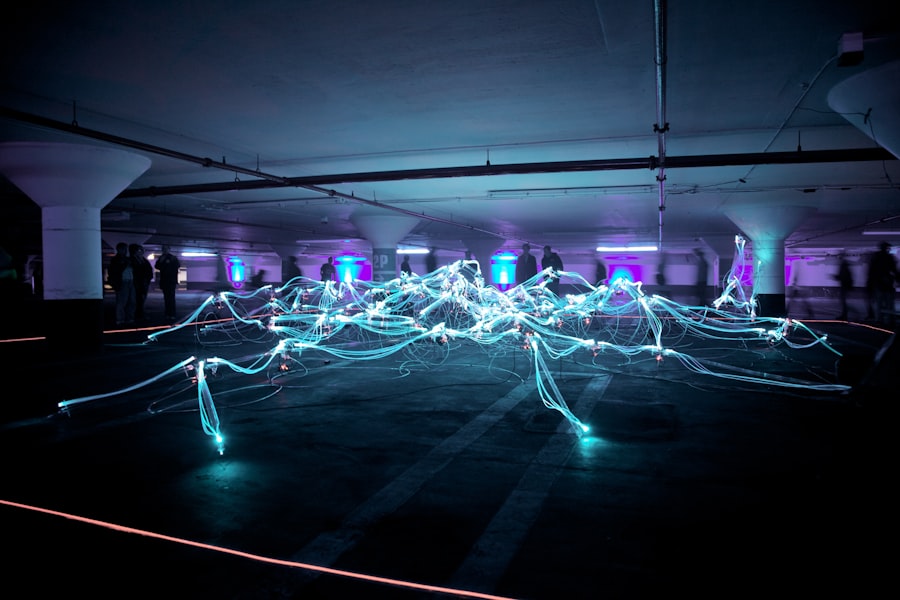

1.2. Alignement Stratégique et Gouvernance : Un Vent de Concordance pour le ML

L’industrialisation du ML ne peut réussir sans un soutien fort et une compréhension claire de la part de la direction générale et des métiers. La stratégie ML doit être un prolongement logique de la stratégie d’entreprise, et non une initiative isolée.

- Mise en place d’une “vision ML” claire : Définissez avec la direction générale où le ML doit mener l’Institut dans les 3 à 5 prochaines années. Cette vision doit être partagée et comprise par tous.

- Constitution d’une équipe pluridisciplinaire : Les projets ML ne sont pas l’apanage des data scientists seuls. Impliquer des experts métiers (actuaires, gestionnaires de sinistres, commerciaux, juristes) dès le début est fondamental pour garantir la pertinence et l’applicabilité des modèles.

- Établissement d’une gouvernance des modèles : Qui est responsable de la validation, du déploiement, de la maintenance et de la supervision des modèles ML ? Une structure de gouvernance claire, incluant des comités de validation et des processus d’escalade, est indispensable pour éviter toute dérive et assurer la conformité réglementaire.

2. Infrastructure et Données : La Forge des Modèles Industrialisés

L’industrialisation du ML repose sur des fondations solides en matière d’infrastructure technique et de qualité des données. Sans un environnement propice, même les algorithmes les plus sophistiqués resteront des exercices de laboratoire, incapables de supporter la charge et la complexité de la production.

2.1. Architecture Technique : De l’Atelier à l’Usine Modulaire

Déployer un modèle ML en production, c’est lui permettre de fonctionner de manière fiable, évolutive et sécurisée, à la demande et à grande échelle. Cela requiert une architecture cible bien définie.

- Plateforme ML robuste et scalable : Optez pour une plateforme qui supporte l’ensemble du cycle de vie du ML, de l’expérimentation au déploiement et à la surveillance. Les solutions cloud offrent une flexibilité et une scalabilité intéressantes, mais une analyse de coût-bénéfice par rapport à des solutions on-premise est nécessaire.

- Automatisation des pipelines MLOps : L’automatisation est la clé de l’industrialisation. La mise en place de pipelines CI/CD (Continuous Integration/Continuous Deployment) pour le ML (MLOps) permet d’automatiser le développement, le test, le déploiement, la surveillance et le réentraînement des modèles. Considérez cela comme le processus de fabrication automatisé de vos modèles.

- Infrastructure de traitement et de stockage des données : Assurez-vous d’avoir les capacités nécessaires pour traiter et stocker de grands volumes de données, tout en garantissant des temps de réponse acceptables pour les applications métiers qui consommeront les prédictions du ML. Pensez aux architectures de type Data Lakehouse, qui combinent la flexibilité du Data Lake avec la structure du Data Warehouse.

- Sécurité et conformité : L’architecture doit intégrer dès le départ les exigences de sécurité et de conformité (RGPD, Solvabilité II, etc.), notamment en matière de gouvernance des données, d’anonymisation/pseudonymisation et de gestion des accès.

2.2. Qualité et Accessibilité des Données : Le Carburant Indispensable

Les modèles ML sont aussi bons que les données sur lesquelles ils sont entraînés. Des données de mauvaise qualité ou inaccessibles sont autant de freins à l’industrialisation.

- Stratégie de gestion des données : Mettez en place une stratégie claire pour la collecte, le nettoyage, la standardisation et la documentation des données. C’est le socle de confiance pour vos modèles.

- Dumping de données et création de pools de données : Consolidez vos données issues de sources hétérogènes (systèmes de gestion de contrats, CRM, gestion des sinistres, sources externes) dans des référentiels unifiés et facilement accessibles pour les équipes ML.

- Data Cataloging et data lineage : Savoir d’où viennent les données, comment elles ont été transformées et qui les utilise est crucial pour la reproductibilité, l’auditabilité et la conformité. Un catalogue de données bien tenu est comme une carte exhaustive de votre territoire de données.

- Gestion de la qualité des données en temps réel : Déployez des mécanismes de surveillance et d’alerte pour détecter les anomalies et les erreurs dans les flux de données en amont de l’entraînement ou de l’inférence des modèles.

3. Développement et Validation des Modèles : De l’Expérimentation Prudente au Pilote Robuste

Le passage du pilote à l’industrialisation ne signifie pas que les painstaking work de développement et de validation s’arrête. Au contraire, il se professionnalise et se systématise.

3.1. Ingénierie des Caractéristiques (Feature Engineering) et Sélection : La Raffinage des Indicateurs

Les caractéristiques (features) que vous fournissez à vos modèles ML sont le sel de vos prédictions. Une bonne ingénierie de caractéristiques permet d’améliorer significativement la performance d’un modèle sans nécessairement recourir à des algorithmes plus complexes.

- Automatisation du feature engineering : Si possible, explorez des techniques d’automatisation pour générer et tester un grand nombre de caractéristiques potentiellement pertinentes.

- Gestion des dépendances et des versions des features : Assurez-vous que les caractéristiques utilisées dans les modèles en production sont les mêmes que celles qui ont été validées lors des phases de développement. Un registre centralisé des caractéristiques est ici une bonne pratique.

- Explicabilité des caractéristiques : Comprendre quelles caractéristiques influencent le plus les prédictions est essentiel, surtout dans notre secteur où la transparence réglementaire est de mise. Cela facilite également le débogage et l’interprétation des modèles par les experts métiers.

3.2. Validation Rigoureuse et Métriques de Performance : Au-delà de la Précision Globale

La validation d’un modèle ML en phase de pilote se concentre souvent sur des métriques simples. Pour l’industrialisation, il faut monter en gamme et adopter une approche plus holistique et axée sur les risques.

- Choix des métriques appropriées au métier : La précision globale n’est souvent pas suffisante. Utilisez des métriques qui reflètent l’impact métier : taux de faux positifs/négatifs dans la détection de fraude, couverture du risque dans la souscription, efficacité des recommandations, etc.

- Validation croisée et tests indépendants : Mettez en place des protocoles de validation robustes qui simulent les conditions réelles d’utilisation du modèle. Cela inclut le test sur des populations de données non vues lors de l’entraînement et, idéalement, des tests A/B (ou A/B/n) en production.

- Tests de robustesse et de sensibilité : Évaluez comment le modèle réagit à des variations mineures dans les données d’entrée (ex: bruit, valeurs manquantes) et comment il se comporte face à des changements significatifs dans la distribution des données. C’est une forme de “stress test” pour votre modèle.

- Validation par les métiers et les experts : Ne sous-estimez jamais le jugement des actuaires ou des experts sinistres. Leurs retours qualitatifs sont souvent cruciaux pour identifier des biais ou des incompréhensions du modèle face à la réalité.

4. Déploiement et Intégration : L’Accouchement dans le Système de Production

Le déploiement d’un modèle ML en production est l’équivalent de mettre une nouvelle machine sophistiquée dans une chaîne de fabrication existante. Il faut que la transition soit fluide pour ne pas paralyser l’ensemble de la ligne. C’est le moment où vous passez de la démonstration à l’application concrète et à grande échelle.

4.1. Stratégies de Déploiement : Gérer l’Entrée dans le Système

Le choix de la stratégie de déploiement dépend de la criticité du modèle, de la complexité de son intégration et du niveau de risque acceptable.

- Déploiement par lots (Batch Deployment) : Idéal pour des cas d’usage où les prédictions ne sont pas nécessaires en temps réel, comme l’analyse de risque pour de nouvelles polices ou la détection de fraude a posteriori.

- Déploiement en temps réel (Real-time Deployment) : Indispensable pour des applications nécessitant des réponses instantanées, comme la validation d’opérations ou la personnalisation d’une offre en ligne. Cela implique le déploiement du modèle comme un service (API).

- Déploiement en mode “shadow” (Shadow Mode) : Une approche prudente où le modèle ML tourne en parallèle du processus existant sans impact sur les décisions finales. Les sorties du modèle sont enregistrées et analysées pour évaluer sa performance avant de le mettre en production réelle. C’est comme faire voler un avion de test à côté du pilote habituel pour vérifier ses réactions.

- Déploiement Canary : Le nouveau modèle est déployé sur un petit sous-ensemble de trafic avant d’être généralisé à tous les utilisateurs. Cela permet de détecter rapidement des problèmes avant qu’ils n’affectent une grande partie de la clientèle.

4.2. Intégration aux Systèmes Existants : Le Mariage Technique

L’intégration d’un modèle ML dans l’écosystème informatique existant est souvent l’un des défis les plus ardus. Il nécessite une coordination étroite avec les équipes IT et métier.

- Développement d’APIs robustes : Pour les modèles déployés en temps réel, la création d’APIs performantes, sécurisées et bien documentées est primordiale pour permettre aux applications métiers de consommer efficacement les prédictions du ML.

- Interfaçage avec les systèmes transactionnels : Assurez-vous que les résultats du modèle ML peuvent être facilement intégrés dans les flux de travail existants des outils de gestion des polices, de gestion des sinistres, ou des plateformes relationnelles client (CRM).

- Gestion des versions des modèles dans l’écosystème : Comment gérez-vous les mises à jour de vos modèles ML ? Faut-il mettre à jour simultanément les APIs et les systèmes consommateurs ? Une stratégie claire de gestion des versions est essentielle.

- Tests d’intégration et d’acceptation utilisateur (UAT) : Avant la mise en production, des tests approfondis sont nécessaires pour vérifier que le modèle interagit correctement avec l’ensemble des systèmes impliqués et que les utilisateurs finaux le perçoivent comme utile et fiable.

5. Surveillance, Maintenance et Évolution : Le Cycle de Vie Infini du ML

| Étape | Description | Objectif | Indicateurs clés | Risques potentiels |

|---|---|---|---|---|

| 1. Identification du cas d’usage | Définir clairement le problème à résoudre avec le machine learning | Aligner le projet avec les besoins métiers | Nombre de cas d’usage validés, pertinence métier | Mauvaise définition du périmètre, attentes irréalistes |

| 2. Collecte et préparation des données | Rassembler et nettoyer les données nécessaires à l’entraînement | Assurer la qualité et la représentativité des données | Taux de données manquantes, qualité des données | Données biaisées, données insuffisantes |

| 3. Développement du modèle pilote | Créer un prototype de modèle ML pour valider la faisabilité | Tester la performance initiale du modèle | Précision, rappel, F1-score du modèle | Surapprentissage, sous-apprentissage |

| 4. Validation métier et réglementaire | Vérifier la conformité et l’acceptabilité du modèle | Respecter les contraintes légales et éthiques | Nombre de non-conformités détectées | Non-respect des normes, biais discriminatoires |

| 5. Industrialisation et déploiement | Intégrer le modèle dans les systèmes de production | Assurer la robustesse et la scalabilité | Temps de latence, taux de disponibilité | Problèmes d’intégration, défaillances en production |

| 6. Suivi et maintenance | Surveiller la performance et mettre à jour le modèle | Maintenir la pertinence et la fiabilité dans le temps | Dérive du modèle, fréquence des mises à jour | Dégradation des performances, obsolescence |

L’industrialisation du ML ne s’arrête pas au déploiement. C’est un processus dynamique qui exige une surveillance constante, une maintenance proactive et une adaptation continue.

5.1. Surveillance Continue des Modèles : Garder un Œil sur la Performance

Les modèles ML, comme tout système vivant, peuvent se dégrader avec le temps. La surveillance est donc une étape clé pour garantir leur pertinence et leur fiabilité.

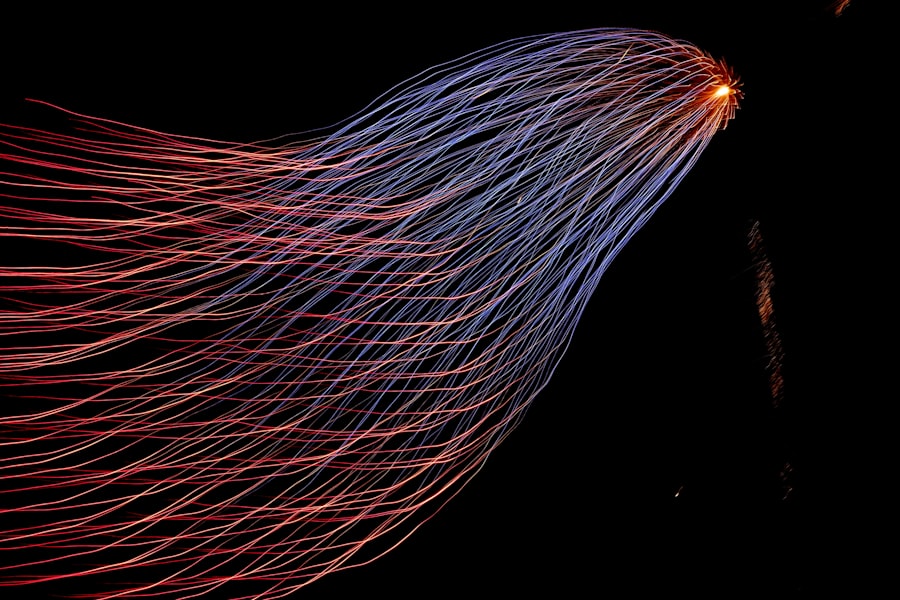

- Surveillance de la dérive des données (Data Drift) : Les caractéristiques des données d’entrée peuvent évoluer au fil du temps, rendant les prédictions du modèle moins précises. Il est crucial de détecter ces changements et de déclencher des alertes.

- Surveillance de la dérive du concept (Concept Drift) : La relation entre les caractéristiques et la cible prédite peut changer, par exemple suite à l’évolution des comportements des assurés ou à des changements réglementaires.

- Surveillance des performances métier : Suivez les KPI métiers associés au modèle ML et recherchez tout écart par rapport aux attentes initiales. Est-ce que la réduction des fraudes se maintient ? Est-ce que les recommandations génèrent toujours autant de conversions ?

- Tableaux de bord de surveillance : Mettez en place des tableaux de bord visuels qui synthétisent les indicateurs clés de performance et de dérive des modèles. C’est votre système d’alerte précoce.

5.2. Maintenance et Réentraînement : Maintenir le Modèle en Forme

La maintenance et le réentraînement réguliers sont indispensables pour que vos modèles continuent à fournir des prédictions fiables et pertinentes.

- Définition d’une politique de réentraînement : Fréquence, triggers (basés sur la performance, la dérive, de nouvelles données), et scope du réentraînement.

- Automatisation du réentraînement : Intégrez le réentraînement dans vos pipelines MLOps pour qu’il se fasse de manière automatisée et reproductible.

- Gestion des versions des modèles entraînés : Maintenez un historique clair des différentes versions de vos modèles, de leurs performances et des données utilisées pour leur entraînement. Ce “versionnement” est essentiel pour l’auditabilité et le rollback si nécessaire.

- Décommissionnement des modèles obsolètes : Mettez en place un processus clair pour désactiver et archiver les modèles qui ne sont plus pertinents ou dont la performance est devenue insuffisante.

5.3. Adoption et Formation des Utilisateurs : Le Facteur Humain

Même le modèle le plus performant du monde sera inutile s’il n’est pas adopté et utilisé correctement par les équipes métiers.

- Formation continue : Formez vos équipes à comprendre comment utiliser les prédictions du ML, à interpréter leurs résultats et à savoir quand faire confiance au système et quand il convient de la supplanter par leur jugement expert.

- Feedback loop : Créez des canaux pour que les utilisateurs puissent faire remonter leurs observations, leurs suggestions et les éventuels problèmes rencontrés avec les modèles ML. Ce feedback est une mine d’or pour l’amélioration continue.

- Accompagnement au changement : L’introduction du ML peut être perçue comme une menace par certaines équipes. Un accompagnement au changement, axé sur la communication, la formation et la mise en avant des bénéfices pour les employés (réduction des tâches répétitives, focalisation sur des missions à plus forte valeur ajoutée), est fondamental.

En conclusion, le passage du projet pilote à l’industrialisation du Machine Learning dans les Instituts de Prévoyance est une entreprise complexe mais déterminante pour leur avenir. Cette « check-list » se veut un guide pratique, une invitation à structurer votre approche, à anticiper les défis et à maximiser les bénéfices de cette révolution technologique. Rappelez-vous que si les algorithmes sont les rouages de cette nouvelle ère, c’est la rigueur stratégique, la qualité des données, la robustesse de l’infrastructure et l’alignement des équipes qui forgeront le succès pérenne de vos initiatives. Le chemin est exigeant, mais les récompenses – efficacité accrue, meilleure gestion des risques, expériences client enrichies – sont à la hauteur de l’effort.