Structurer une stratégie IA cohérente avec les enjeux réglementaires

L’intelligence artificielle (IA) est devenue un moteur essentiel de l’innovation dans de nombreux secteurs, mais elle soulève également des préoccupations réglementaires significatives. Les enjeux réglementaires liés à l’IA sont multiples et complexes, englobant des questions de sécurité, de responsabilité, de transparence et d’éthique. Par exemple, les systèmes d’IA peuvent prendre des décisions qui affectent directement la vie des individus, comme dans le cas des algorithmes de crédit ou des systèmes de reconnaissance faciale.

Ces décisions peuvent être biaisées ou discriminatoires si les données d’entraînement ne sont pas soigneusement sélectionnées et vérifiées. Ainsi, il est crucial pour les entreprises de comprendre non seulement les lois existantes, mais aussi les implications éthiques de l’utilisation de l’IA. De plus, la rapidité d’évolution de la technologie rend difficile l’élaboration de réglementations adaptées.

Les législateurs doivent naviguer dans un paysage en constante mutation, où les innovations peuvent rapidement rendre obsolètes les cadres juridiques en place. Par conséquent, les entreprises doivent être proactives dans leur approche réglementaire, en intégrant des mécanismes de conformité dès la phase de conception de leurs systèmes d’ICela implique une compréhension approfondie des lois en vigueur et une anticipation des futures régulations qui pourraient émerger à mesure que la technologie continue d’évoluer.

Résumé

- Comprendre les enjeux réglementaires liés à l’IA

- Identifier les principaux cadres réglementaires applicables à l’IA

- Intégrer la protection des données personnelles dans la stratégie IA

- Évaluer les risques éthiques associés à l’IA et les mesures de conformité

- Impliquer les parties prenantes dans la définition de la stratégie IA

Identifier les principaux cadres réglementaires applicables à l’IA

Le règlement de l’Union européenne

L’Union européenne, par exemple, a proposé un règlement sur l’IA qui vise à établir un cadre juridique harmonisé pour l’utilisation de cette technologie au sein de ses États membres. Ce règlement classe les applications d’IA en fonction de leur niveau de risque, allant des systèmes à faible risque aux systèmes à risque élevé, tels que ceux utilisés dans le domaine de la santé ou de la justice.

Une approche adaptée aux risques

Cette approche permet d’adapter les exigences réglementaires en fonction du potentiel d’impact sur les droits fondamentaux des citoyens.

Les normes internationales

En outre, des normes internationales telles que celles établies par l’ISO (Organisation internationale de normalisation) et l’IEEE (Institute of Electrical and Electronics Engineers) commencent également à jouer un rôle crucial dans la définition des bonnes pratiques en matière d’IA. Ces normes visent à garantir que les systèmes d’IA soient conçus et déployés de manière responsable, en tenant compte des préoccupations éthiques et sociales. Les entreprises doivent donc se familiariser avec ces cadres pour s’assurer qu’elles respectent non seulement les exigences légales, mais aussi les attentes sociétales croissantes en matière de responsabilité et d’éthique.

Intégrer la protection des données personnelles dans la stratégie IA

La protection des données personnelles est un aspect fondamental à considérer lors du développement et du déploiement de solutions d’IAvec l’entrée en vigueur du Règlement général sur la protection des données (RGPD) en Europe, les entreprises doivent veiller à ce que leurs systèmes d’IA respectent strictement les droits des individus concernant leurs données personnelles. Cela inclut le droit à l’information, le droit d’accès, le droit à la rectification et le droit à l’effacement. Par conséquent, il est impératif que les entreprises intègrent ces principes dès la conception de leurs systèmes d’IA, un concept connu sous le nom de “privacy by design”.

Pour ce faire, les entreprises doivent mettre en place des processus robustes pour garantir que seules les données nécessaires sont collectées et utilisées. Cela implique une évaluation minutieuse des données d’entraînement utilisées pour alimenter les algorithmes d’IA afin d’éviter toute collecte excessive ou inappropriée. De plus, il est essentiel d’assurer la transparence vis-à-vis des utilisateurs concernant la manière dont leurs données sont utilisées et protégées.

En intégrant ces considérations dans leur stratégie IA, les entreprises peuvent non seulement se conformer aux exigences légales, mais aussi renforcer la confiance des utilisateurs dans leurs produits et services.

Évaluer les risques éthiques associés à l’IA et les mesures de conformité

L’évaluation des risques éthiques liés à l’IA est une étape cruciale pour toute organisation souhaitant adopter cette technologie. Les systèmes d’IA peuvent reproduire ou amplifier des biais existants dans les données, ce qui peut entraîner des conséquences néfastes pour certains groupes sociaux. Par exemple, des études ont montré que certains algorithmes de recrutement favorisent systématiquement certains profils au détriment d’autres en raison de biais historiques présents dans les données d’entraînement.

Pour atténuer ces risques, il est essentiel que les entreprises mettent en place des mécanismes de contrôle rigoureux pour identifier et corriger ces biais. Les mesures de conformité doivent également inclure une formation continue sur l’éthique de l’IA pour tous les employés impliqués dans le développement et le déploiement de ces technologies. Cela peut impliquer des ateliers sur la reconnaissance des biais, ainsi que sur les implications éthiques des décisions prises par les systèmes d’IEn intégrant une culture éthique au sein de l’organisation, les entreprises peuvent non seulement se conformer aux exigences réglementaires, mais aussi contribuer à un développement responsable et équitable de l’intelligence artificielle.

Impliquer les parties prenantes dans la définition de la stratégie IA

L’implication des parties prenantes est essentielle pour élaborer une stratégie IA qui soit à la fois efficace et responsable. Cela inclut non seulement les employés et les dirigeants au sein de l’organisation, mais aussi les clients, les régulateurs et même la société civile. En engageant un dialogue ouvert avec ces différents acteurs, les entreprises peuvent mieux comprendre leurs préoccupations et attentes concernant l’utilisation de l’IPar exemple, une entreprise qui développe un système d’IA pour le secteur médical pourrait organiser des consultations avec des professionnels de santé, des patients et des experts en éthique pour recueillir leurs avis sur le déploiement de cette technologie.

De plus, cette approche collaborative peut également favoriser l’innovation. En intégrant divers points de vue dans le processus décisionnel, les entreprises peuvent découvrir de nouvelles opportunités et identifier des risques potentiels qu’elles n’auraient pas envisagés autrement. Cela peut également renforcer la légitimité et l’acceptabilité sociale des projets d’IA, car les parties prenantes se sentiront davantage impliquées dans le processus et seront plus susceptibles de soutenir son adoption.

Mettre en place des processus de gouvernance pour assurer la conformité réglementaire

Structure organisationnelle dédiée

Cela implique la création d’une structure organisationnelle dédiée à la supervision des projets d’IA, avec des rôles clairement définis pour assurer la responsabilité et la transparence. Par exemple, certaines entreprises nomment un responsable de la conformité en matière d’IA qui est chargé de surveiller toutes les activités liées à cette technologie et d’assurer leur conformité avec les lois en vigueur.

Suivi et évaluation continue

En outre, il est essentiel d’établir des protocoles clairs pour le suivi et l’évaluation continue des systèmes d’IA déployés. Cela peut inclure des audits réguliers pour vérifier que les algorithmes fonctionnent comme prévu et qu’ils ne présentent pas de biais ou d’autres problèmes éthiques.

Réputation et minimisation des risques

En intégrant ces processus dans leur gouvernance, les entreprises peuvent non seulement minimiser le risque de non-conformité, mais aussi renforcer leur réputation en tant qu’acteurs responsables dans le domaine de l’intelligence artificielle.

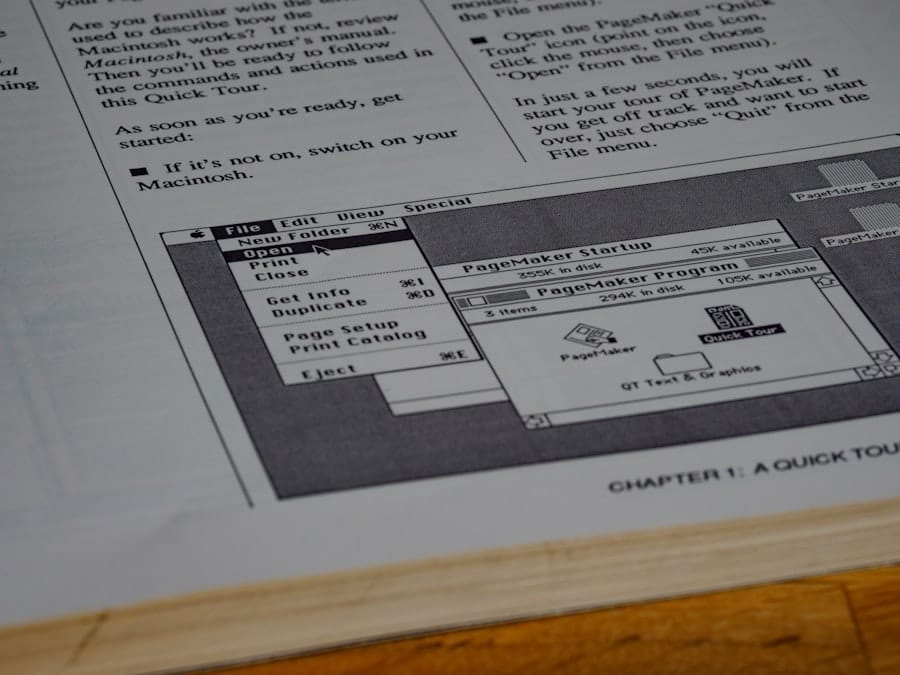

Former les équipes sur les enjeux réglementaires liés à l’IA

La formation des équipes sur les enjeux réglementaires liés à l’IA est une étape essentielle pour garantir une mise en œuvre réussie et conforme de cette technologie. Les employés doivent être conscients des lois et règlements qui régissent l’utilisation de l’IA dans leur secteur spécifique, ainsi que des implications éthiques associées à leur travail. Cela peut inclure des sessions de formation sur le RGPD, sur la manière dont il s’applique aux projets d’IA, ainsi que sur les meilleures pratiques pour garantir la protection des données personnelles.

De plus, il est important que cette formation soit continue et évolutive afin de s’adapter aux changements rapides du paysage réglementaire. Les entreprises peuvent organiser régulièrement des ateliers ou des séminaires pour tenir leurs équipes informées des nouvelles législations ou directives pertinentes. En investissant dans la formation continue, elles s’assurent que leurs employés sont bien équipés pour naviguer dans le cadre complexe et en constante évolution qui entoure l’intelligence artificielle.

Collaborer avec les autorités de régulation pour garantir la conformité

La collaboration avec les autorités de régulation est un aspect fondamental pour assurer la conformité réglementaire dans le domaine de l’ILes entreprises doivent établir un dialogue constructif avec ces organismes afin de mieux comprendre leurs attentes et préoccupations concernant l’utilisation de l’intelligence artificielle. Cela peut inclure la participation à des consultations publiques ou à des groupes de travail organisés par les régulateurs pour discuter des enjeux liés à l’IA. En outre, cette collaboration peut également permettre aux entreprises d’influencer positivement le développement futur des réglementations en matière d’IEn partageant leur expertise et leurs expériences avec les autorités compétentes, elles peuvent contribuer à façonner un cadre réglementaire qui soit à la fois protecteur pour les consommateurs et favorable à l’innovation.

Cette approche proactive peut également renforcer la réputation des entreprises en tant qu’acteurs responsables et engagés dans le développement éthique de l’intelligence artificielle.

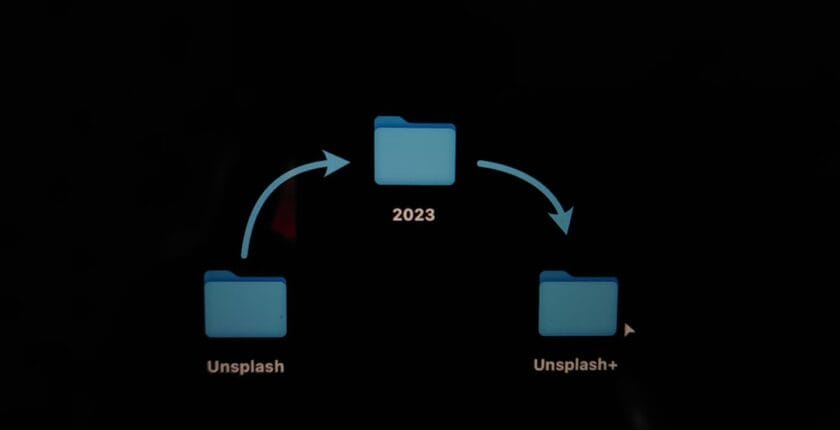

Adapter la stratégie IA aux évolutions réglementaires

L’adaptabilité est essentielle dans le domaine dynamique de l’intelligence artificielle, surtout face aux évolutions réglementaires constantes. Les entreprises doivent être prêtes à ajuster leur stratégie IA en fonction des nouvelles lois ou directives qui émergent. Cela nécessite une veille active sur le paysage réglementaire afin d’identifier rapidement tout changement susceptible d’affecter leurs opérations.

Par exemple, si une nouvelle réglementation impose des exigences supplémentaires en matière de transparence algorithmique, une entreprise devra revoir ses pratiques pour s’assurer qu’elle respecte ces nouvelles obligations. De plus, cette capacité d’adaptation doit être intégrée dans la culture organisationnelle. Les équipes doivent être encouragées à faire preuve de flexibilité et à anticiper les changements plutôt que simplement réagir après coup.

Cela peut impliquer la mise en place de mécanismes internes permettant une réévaluation régulière des projets IA afin qu’ils restent conformes aux exigences légales tout en continuant à répondre aux besoins du marché.

Mesurer l’impact des enjeux réglementaires sur la stratégie IA

Mesurer l’impact des enjeux réglementaires sur la stratégie IA est crucial pour évaluer l’efficacité des mesures mises en place par une entreprise. Cela peut impliquer l’utilisation d’indicateurs clés de performance (KPI) spécifiques qui permettent d’évaluer non seulement la conformité réglementaire mais aussi son influence sur l’innovation et la satisfaction client. Par exemple, une entreprise pourrait suivre le nombre d’audits réussis réalisés sur ses systèmes d’IA ou mesurer le temps nécessaire pour répondre aux demandes liées aux droits des utilisateurs sous le RGPD.

En outre, il est important d’analyser comment ces enjeux réglementaires affectent également la perception publique et la confiance envers l’entreprise. Des enquêtes régulières auprès des clients peuvent fournir un aperçu précieux sur leur perception concernant la manière dont leurs données sont traitées et protégées par l’entreprise. En intégrant ces mesures dans leur stratégie IA, les entreprises peuvent non seulement s’assurer qu’elles respectent leurs obligations légales mais aussi renforcer leur position sur le marché.

Assurer une veille réglementaire continue pour maintenir la cohérence de la stratégie IA

La mise en place d’une veille réglementaire continue est essentielle pour maintenir la cohérence et la pertinence de la stratégie IA au sein d’une entreprise. Cela implique non seulement le suivi actif des évolutions législatives au niveau national et international mais aussi une analyse approfondie des tendances émergentes dans le domaine technologique et éthique lié à l’intelligence artificielle. Les entreprises peuvent tirer parti d’outils technologiques tels que les alertes automatisées ou les plateformes spécialisées qui fournissent régulièrement des mises à jour sur les changements réglementaires pertinents.

De plus, il est bénéfique d’établir un réseau avec d’autres acteurs du secteur afin d’échanger sur les meilleures pratiques en matière de conformité réglementaire liée à l’IParticiper à des conférences ou rejoindre des associations professionnelles peut offrir aux entreprises une perspective précieuse sur comment leurs pairs abordent ces défis communs. En assurant une veille réglementaire proactive et collaborative, elles peuvent non seulement rester conformes mais aussi anticiper les changements futurs qui pourraient influencer leur stratégie IA.